时间:2023-06-08 11:53:40

作者:景联文科技

浏览: 次

由OpenAI推出的强大的生成式预训练转换器(GPT)语言模型开辟了自然语言处理(NLP)的新领域。将GPT模型集成到虚拟助手和聊天机器人中可增强其功能,从而导致对GPT模型的需求激增。 根据 AlliedMarketResearch发布的一份题为“全球 NLP市场”的报告,2020年全球NLP市场规模为111亿美元,预计到2030年将达到3415亿美元,2021年至2030年的复合年增长率为40.9%。

GPT模型是由OpenAI团队创建的基于深度学习的语言模型的集合。在没有监督的情况下,这些模型可以执行各种NLP任务,如问答、文本蕴含、文本摘要等。

训练最多的GPT模型——GPT-4,超过1万亿个学习参数,比任何语言模型都要强大不止十倍。与其他模型相比,它的优势在于无需大量调整即可执行任务;它只需要很少的文本交互演示,其余的由模型完成。经过高级训练的GPT模型可以通过执行语言翻译、文本摘要、问答、聊天机器人集成、内容生成、情感分析、命名实体识别、文本分类、文本完成、文本到语音合成等等,让生活变得更轻松。

什么是GPT模型?

GPT代表GenerativePre-trainedTransformer,NLP中的第一个通用语言模型。以前,语言模型仅针对文本生成、摘要或分类等单一任务而设计。GPT是自然语言处理史上第一个可用于各种NLP任务的通用语言模型。现在让我们探索GPT的三个组成部分,即Generative、Pre-Trained和Transformer,并了解它们的含义。

生成:生成模型是用于生成新数据的统计模型。这些模型可以学习数据集中变量之间的关系,以生成与原始数据集中的数据点相似的新数据点。

预训练:这些模型已经使用大型数据集进行了预训练,可以在难以训练新模型时使用。尽管预训练模型可能并不完美,但它可以节省时间并提高性能。

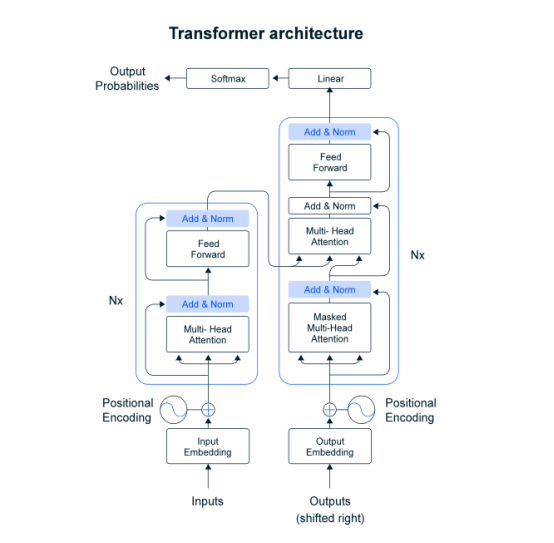

Transformer: Transformer模型是一种人工神经网络,创建于2017年,是最著名的深度学习模型,能够处理文本等顺序数据。机器翻译和文本分类等许多任务都是使用转换器模型执行的。

GPT可以根据其训练的大型数据集及其数十亿参数的架构高精度地执行各种NLP任务,使其能够理解数据中的逻辑连接。GPT模型,如最新版本的GPT-3,已经使用来自五个大型数据集的文本进行了预训练,包括CommonCrawl和WebText2。语料库包含近万亿个单词,使GPT-3能够在没有任何数据示例的情况下快速执行NLP任务。

GPT模型的工作机制

GPT是一种基于transformer架构的AI语言模型,它是预训练的、生成的、无监督的,并且能够在零/一次/少量多任务设置中表现良好。它从用于NLP任务的标记序列中预测下一个标记(字符序列的实例),它尚未接受过训练。在只看到几个例子之后,它可以在某些基准测试中达到预期的结果,包括机器翻译、问答和完形填空任务。GPT模型主要根据条件概率计算某个词出现在另一个文本中的可能性。例如,在“Margaretisorganizingagaragesale…perhapswecouldpurchasethatold…”这句话中,椅子这个词比“大象”这个词更合适。还,transformer模型使用多个称为注意力块的单元来学习要关注文本序列的哪些部分。一个转换器可能有多个注意力模块,每个模块学习一种语言的不同方面。

Transformer架构有两个主要部分:主要对输入序列进行操作的编码器和在训练期间对目标序列进行操作并预测下一项的解码器。例如,转换器可能会采用一系列英语单词并预测正确翻译中的法语单词,直到它完成为止。

编码器确定应强调输入的哪些部分。例如,编码器可以读取“Thequickbrownfoxjumped”这样的句子。然后它计算嵌入矩阵(嵌入在NLP中允许具有相似含义的词具有相似的表示)并将其转换为一系列注意力向量。现在,什么是注意力向量?您可以将Transformer模型中的注意力向量视为一个特殊的计算器,它可以帮助模型了解任何给定信息的哪些部分对做出决策最重要。假设您在考试中被问到多个问题,您必须使用不同的信息片段来回答这些问题。注意力向量可帮助您选择最重要的信息来回答每个问题。在变压器模型的情况下,它以相同的方式工作。

多头注意力块最初产生这些注意力向量。然后将它们归一化并传递到完全连接的层中。在传递给解码器之前再次进行归一化。在训练期间,编码器直接在目标输出序列上工作。假设目标输出是英语句子“Thequickbrownfoxjumped”的法语翻译。解码器为句子中的每个法语单词计算单独的嵌入向量。此外,位置编码器以正弦和余弦函数的形式应用。此外,还使用了maskedattention,这意味着使用了法语句子的第一个词,而所有其他词都被屏蔽了。这允许转换器学习预测下一个法语单词。

与此同时,GPT模型采用了一些数据压缩,同时消耗了数以百万计的样本文本,将单词转换为只是数字表示的向量。然后,语言模型将压缩文本解压缩为人类友好的句子。通过压缩和解压缩文本提高了模型的准确性。这也允许它计算每个单词的条件概率。GPT模型可以在“少量镜头”设置中表现良好,并且可以响应以前见过的文本样本。他们只需要几个例子就可以产生相关的回答,因为他们已经接受过许多文本样本的训练。

此外,GPT模型还有很多能力,比如生成前所未有质量的合成文本样本。如果你用一个输入来启动模型,它会产生一个很长的延续。GPT模型优于在维基百科、新闻和书籍等领域训练的其他语言模型,而无需使用特定领域的训练数据。GPT仅从文本中学习阅读理解、摘要和问答等语言任务,无需特定任务的训练数据。这些任务的分数(“分数”是指模型分配的数值,用于表示给定输出或结果的可能性或概率)不是最好的,但它们建议使用具有足够数据和计算的无监督技术来使任务受益。

在GTP中,数据标注的重要性在于它是图形变换过程中的关键环节,它决定了变换的输入和输出数据的准确性和可靠性。数据标注可以帮助开发人员更好地理解软件中的数据结构和处理流程,使得开发和维护过程更加高效和便捷。因此,数据标注对于GTP的重要性不容忽视,是GTP设计和实现的关键之一。

景联文科技是AI基础数据行业的头部企业,拥有千人从业经验丰富的数据标注团队及丰富的图像和文本标注经验,可为ChatGPT大语言模型提供图像和NLP相关数据采集和数据标注服务,并根据客户需求迅速调配有相关经验的标注员。景联文科技拥有丰富的专家资源,拥有代码、医学、高等数学、世界常识、翻译、文学创作等领域专家可对垂直领域数据信息进行标注,从而保证数据质量,满足当前标注需求。

针对数据定制标注服务,景联文科技拥有先进的数据标注平台与成熟的标注、审核、质检机制,支持计算机视觉:语义分割、矩形框标注、多边形标注、关键点标注、3D立方体标注、2D3D融合标注、目标追踪、属性判别等多类型数据标注;支持自然语言处理:文本清洗、OCR转写、情感分析、词性标注、句子编写、意图匹配、文本判断、文本匹配、文本信息抽取、NLU语句泛化、机器翻译等多类型数据标注。

景联文科技提供的产品为全链条AI数据服务,从数据采集、清洗、标注、到驻场的全流程、垂直领域数据解决方案一站式AI数据服务,满足了不用应用场景下的各类数据采集标注业务的需要,协助人工智能企业解决整个人工智能链条中数据采集标注环节的相对应问题,推动人工智能在更多地场景下实现落地应用,构建完整的AI数据生态。

景联文科技|数据采集|数据标注

助力人工智能技术,赋能传统产业智能化转型升级

在线

在线